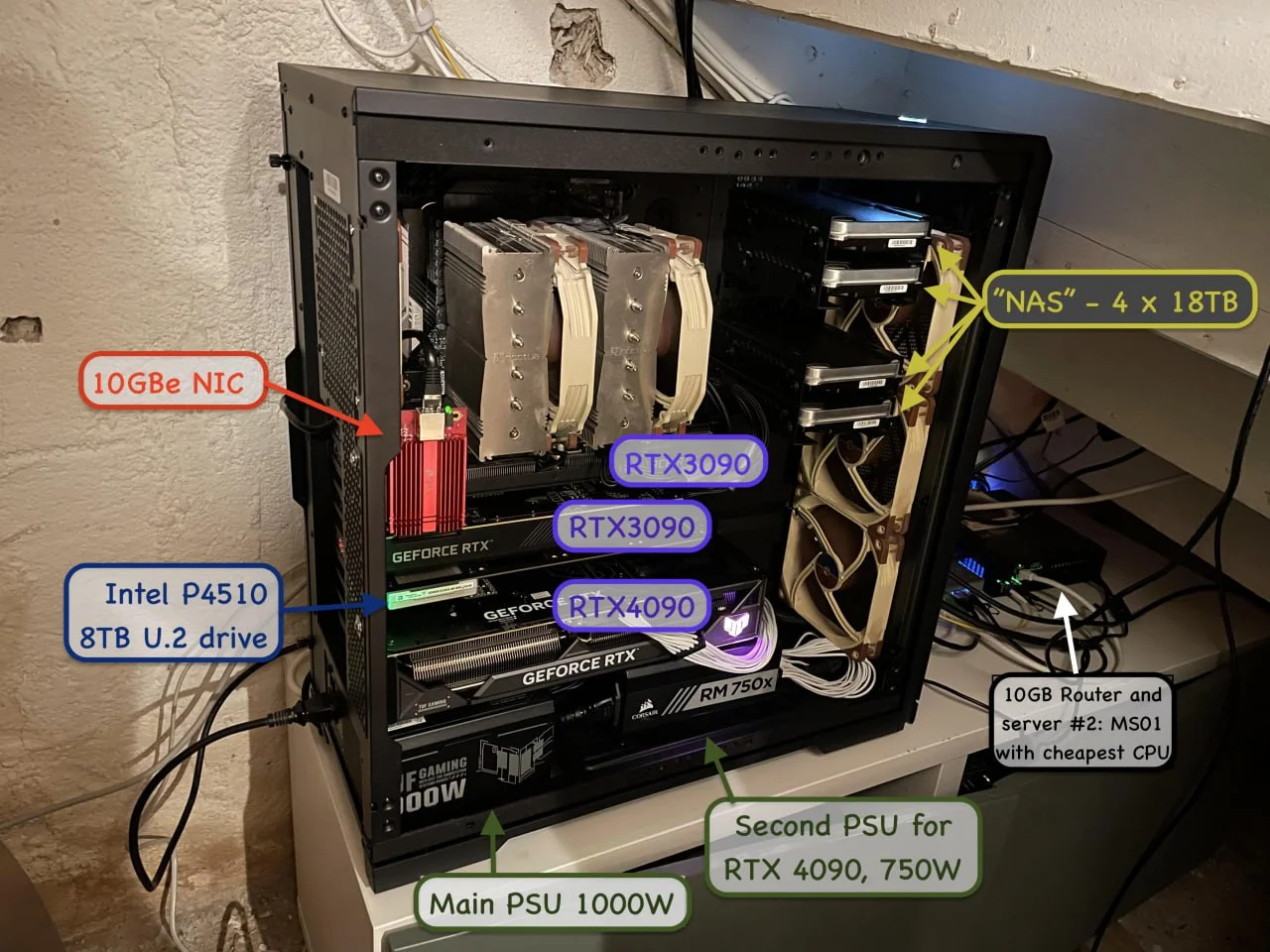

Чел хвастается домашним монстром, собранным для локальных LLM: огромный корпус Phanteks Enthoo Pro 2 Server, связка ASRock X570 Taichi и Ryzen 3950X. Внутри три видеокарты, две RTX 3090 и одна RTX 4090, причем 4090 сидит через цепочку M.2, Oculink, PCIe и питается от второго блока питания.

Хранилище с размахом: Intel P4510 на 8 ТБ U.2 NVMe под виртуалки и четыре HDD Seagate Exos по 18 ТБ под TrueNAS в виртуалке, плюс 10GBe сетевая карта тоже через M.2, PCIe переходник.

По скорости LLM автор гордится тем, что GPT OSS 120B полностью в видеопамяти выдает около 109 токенов в секунду вместо 16 токенов в секунду на двух 3090 с CPU offload...

Еще раз отмечу - 100 токенов в секунду или 300 символов русского языка в секунду выдает это чудовщие :)

Вложения примерно 6370 долларов: CPU 750, материнка 250, RAM 400, NVMe U.2 8 ТБ 650, четыре HDD 18 ТБ по 300 это 1200, 10GBe 100, два M.2 райзера 100, корпус 200, блоки питания 120 и 250, две RTX 3090 по 700 это 1400, RTX 4090 1300.

В РФ сразу прикидывайте на 900 000 р. Мы покупаем API к ИИ и платим условно 7 рублей за 1 млн. исходящих токенов. Если положить 900к под 13% годовых на депозит, можно 10 000 р. в месяц получать и бесплатно генерить безумное количество токенов :)

Русский ИТ бизнес

А те кто надеется на api - не надейтесь. Готовьте кошельки по 60₽ за 200К токенов - это один запрос ответ в чате по кодингу

Там вообще ничего не работает даже Яндекс облако не раздает апи к ии