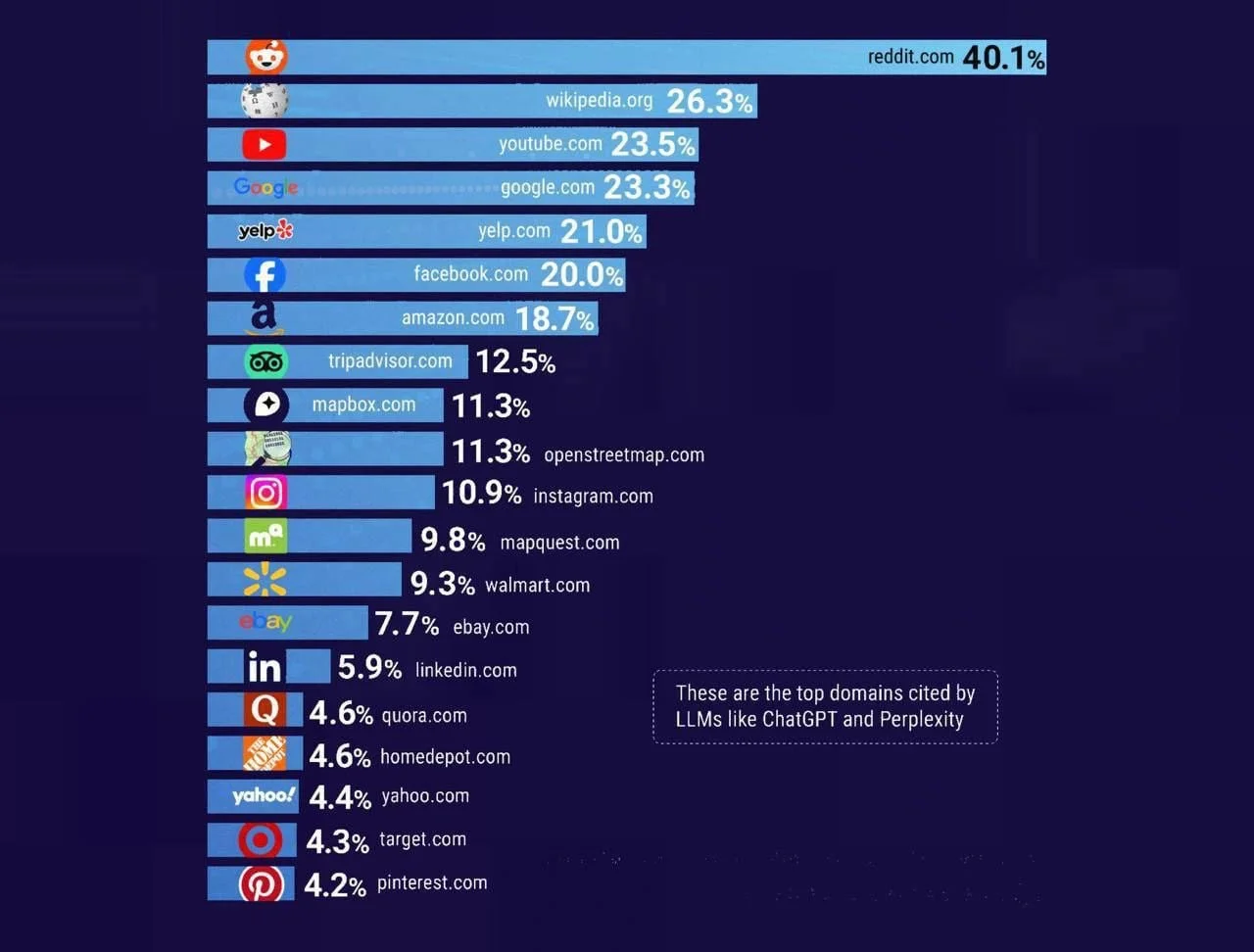

Источник знаний для chatGPT. Превалирует Reddit. Около 40% обучающих данных пришли из форумных тредов. Второй по весу источник - Wikipedia, где много фактов, но не всегда точных. Дальше идут YouTube, Google, Yelp и прочие сервисы.

Все волнуются, ведь получается, что ChatGPT не формирует экспертных знаний, а воспроизводит усреднённое мнение толпы :) Но ведь толпа в массе своей не может ошибаться, да? :)

Русский ИТ бизнес

А если фильтры грамотно задашь - то и результат (выборку) получишь соответствующую)).

Средненький промпт - это одна-две бытовых фразы. Как чукча слышит и видит - так чукча и воспроизводит=спрашивает.

А профессиональный промпт - это полноценная структура, можно сказать - как аналог SQL запроса.

И результаты будут совершенно разные в обоих случаях.

Вот для примера результат CustDev-a на скрине. У меня сам промпт 5 экранных страниц занимает. А результат в отдельном файле - просто песня!

И второй раз акцентирую - результаты в виде маркдаун-файлов.

в чем ценность промпта не ясно - ведь он вытащил инфу именно с форумов

Мне второй Сбер или Револют создавать - потребности нет. Нужные мне задачи - в данный момент ускоряются в разы. Отдельно безопасностью - я ещё не занимался, и хуяк-хуяк в продакшн -ничего не выводил.

Зато сразу видно умников, которые по куску скрина сразу всё-всё поняли, и про цели, и про задачи. И начали свою, конечно же, на 100% правильную, точку зрения транслировать. Миллионы мух не могут ошибаться, ага-ага.

а вот если вопрос об какой нить узкой академической теме то источник будет заведомо более качественный

Не как источник истины, а как источник языковых формул разных языковых доминант вот и всё

Поэтому это просто вброс и хал вар и полное отсутствие понимания как работает ИИ у тех, кто задается вопросом, а что если ии обучался на редите и форумах а там вранье. Значит и знания ии вранье

Вранье или не вранье решает не ии, а фактура

Например перплексети предоставляет источники

https://www.perplexity.ai/search/0e00e17d-625d-43d1-a645-778cb4e33562

OS ни OSS вот в чем вопрос :) и при чем тут автономный суверенитет колхоза про который я весь день пишу

Ни один LLM ничего «не знает» и не обладает экспертизой. Экспертизой обладает ИИ, а это совокупное ПО: RAG + tools + agents (llm) + prompt + params и ещё 100500 настроек

Экспертиза зависит полностью от фактуры

Какие данные для фактуры тебе нужны чтобы составить грамотное описание партии пшена на продажу

И результат превысил мои ожидания:

https://t.me/Russian_IT_Business/327541

Я честно говоря не ожидал такого от яндекс гпт тем более 8b… так что точность зависит от фактуры и промпта, если даже слабые модели могут в утилитарность

Кому то и гороскопы генерить пачками - тоже очень нужное.

что весьма сомнительно по целесообразности

LLM не считает, а гадает. Чтобы LLM посчитала ей нужно вызвать инструмент, например язык пайтон. Тоже и с экспертизой - он обработает предложенное ему инфо и сформулирует т9 ответ, насколько возможно релевантно (нагадает). точность будет полностью зависеть от фактуры

Почему пайтон - это не язык железа, а язык для людей и встроенный в чаты интерпретатор кода

Ему не требуется экспертиза

Еще раз. LLM это не источник экспертных знаний

Это болталка и чем больше параметров тем более точно и качественно болтает

А экспертиза целиком и полностью зависит от фактуры (rag, tools, поиск в интернете и т д)