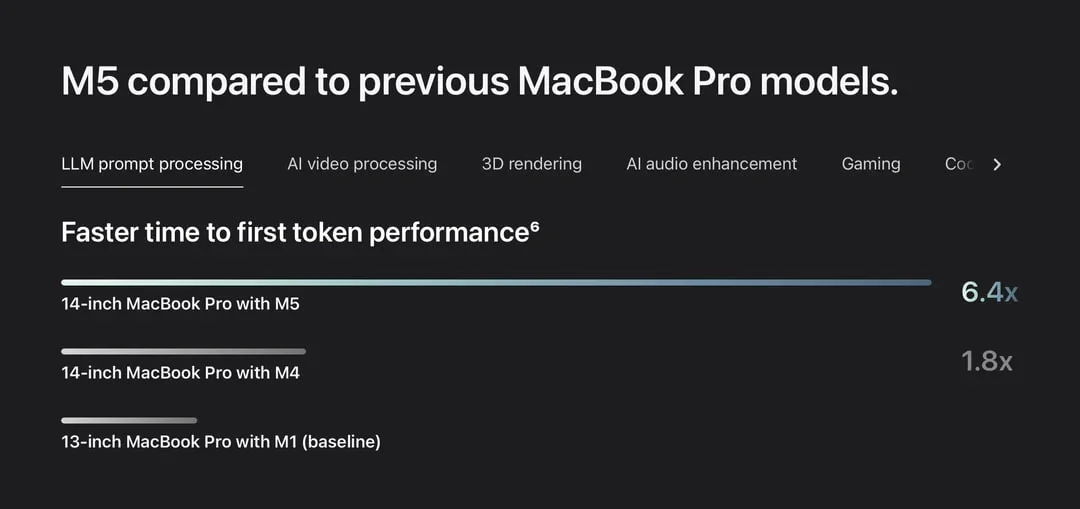

Для апологетов ИИ - новый чип Apple M5 в 6 раз быстрее текущего в части генерации текста (до первого токена). Что это значит? Как минимум, запуск локальных ИИ будет проще и работать они будут быстрее.

Но скажу так - чем сильнее надувается пузырь ИИ, тем дешевле будут токены и меньше смысла в локальных моделях, если их можно за копейки покупать на рынке.

Русский ИТ бизнес

-

Проц это хорошо, только вопрос, где к такому ноуту взять робособаку, которая будет таскать чемодан с оперативной для нормальных моделей...

Проц это хорошо, только вопрос, где к такому ноуту взять робособаку, которая будет таскать чемодан с оперативной для нормальных моделей... -

если вы гоняете свои данные в чужие LLM ки не удивляйтесь потом когда вырастет новый конкурент и вас похоронит.

если вы гоняете свои данные в чужие LLM ки не удивляйтесь потом когда вырастет новый конкурент и вас похоронит.-

Не уверен, что в ближайшее время провайдеры llm заинтересуются парсингом ассортимента Петровича...

Не уверен, что в ближайшее время провайдеры llm заинтересуются парсингом ассортимента Петровича...

-

-

зато когда заинтересуется сосед Петровича и сделает запрос в LLM ку та будет готова выдать ему все расклады. Плати тока за токены

зато когда заинтересуется сосед Петровича и сделает запрос в LLM ку та будет готова выдать ему все расклады. Плати тока за токены -

Ну вот и инфраструктура к gpt-oss открытым моделям подъехала. Можно локально гонять без внешних api

Ну вот и инфраструктура к gpt-oss открытым моделям подъехала. Можно локально гонять без внешних api-

там 32озу, маловато

там 32озу, маловато-

Эта да. Для 120B пока маловато но думаю скоро Mac M5 mini выпустят и тогда их можно соединить в кластер

Эта да. Для 120B пока маловато но думаю скоро Mac M5 mini выпустят и тогда их можно соединить в кластер

-

-

-

Локальные модели нужны для privacy

Локальные модели нужны для privacy -

Когда пузырь лопнет, токены станут гораздо дороже.

Когда пузырь лопнет, токены станут гораздо дороже. -

Офигительно важный показатель - время до первого токена (нет)

Офигительно важный показатель - время до первого токена (нет)